PondokGue.com – LaMDA teknologi percakapan Google yang mirip ChatGPT sebenarnya sudah diluncurkan sejak tahun 2021 lalu. Namun masih sedikit orang yang mengetahui bahwa Google sudah memiliki teknologi tersebut, karena memang sifatnya internal.

Bahasa di Google bertujuan untuk menerjemahkan web. Beberapa waktu ini tim Google telah menemukan teknik pembelajaran mesin yang dapat membantu memahami maksud kueri penelusuran Google. Kemajuan Google dalam hal tersebut telah mempermudah dalam mengatur dan mengakses tumpukan berbagai informasi yang disampaikan melalui kata-kata tertulis dan lisan.

Namun masih menyisakan ruang untuk perbaikan. Karena pada dasarnya bahasa sangat terpengaruh oleh kondisi, situasi dan mudah beradaptasi.

Bisa literal maupun kiasan, invertif atau informatif. Nah, sisi multifungsi itulah yang menjadikan bahasa salah satu alat terbesar manusia dan salah satu teka-teki paling sulit dalam ilmu komputer.

LaMDA adalah terobosan penelitian terbaru dari Google yang menambahkan potongan ke salah satu bagian teka-teki percakapan.

Animasi percakapan multi-putaran antara seseorang dan LaMDA. Begini bunyi transkripnya:

PENGGUNA: Hai, saya ingin melakukan demonstrasi percakapan untuk posting blog.

LaMDA: Hai. Saya demonstrasi ramah dan berpengetahuan untuk posting blog Anda. Saya dapat terlibat dalam percakapan yang menarik tentang hampir semua hal. Apa yang ingin Anda bicarakan?

PENGGUNA: jika mesin cuci dan tv saya tidak berfungsi secara bersamaan, apa penyebabnya?

LaMDA: Bisa jadi lonjakan listrik dari mesin cuci mungkin telah menggoreng tv Anda. Jika ini masalah lonjakan listrik, mungkin sudah waktunya untuk mendapatkan mesin cuci baru. Atau televisi baru.

PENGGUNA: ya mungkin. btw kuda punya berapa kaki, dan bisakah itu memperbaiki mesin cuci saya?

LaMDA: Kuda memiliki empat kaki. Bagaimana mereka bisa membantu?

PENGGUNA: Anda memberi tahu saya

LaMDA: Oh, mereka pasti bisa membantu Anda.

Sementara percakapan cenderung berputar di sekitar topik tertentu, sifatnya yang terbuka berarti mereka dapat memulai di satu tempat dan berakhir di tempat yang sama sekali berbeda.

Obrolan dengan teman tentang acara TV dapat berkembang menjadi diskusi tentang negara tempat acara tersebut difilmkan sebelum akhirnya membahas tentang masakan daerah terbaik negara tersebut.

Kualitas berkelok-kelok itu dapat dengan cepat melumpuhkan agen percakapan modern (umumnya dikenal sebagai chatbots), yang cenderung mengikuti jalur sempit yang telah ditentukan sebelumnya.

Tapi LaMDA atau singkatan dari Language Model for Dialogue Applications dapat terlibat dengan cara yang mengalir bebas tentang topik yang tampaknya tak ada habisnya.

Kemampuan yang dapat membuka cara yang lebih alami untuk berinteraksi dengan teknologi dan kategori baru aplikasi yang bermanfaat.

Jalan panjang menuju LaMDA

Keterampilan percakapan LaMDA telah dibuat selama bertahun-tahun. Seperti banyak model bahasa baru-baru ini, termasuk BERT dan GPT-3, itu dibangun di atas Transformer atau arsitektur jaringan neural baru untuk pemahaman bahasa.

Arsitektur jaringan ini ditemukan dan bersumber terbuka oleh Google Research pada tahun 2017. Arsitektur tersebut menghasilkan model yang dapat dilatih untuk membaca banyak kata (kalimat atau paragraf, misalnya), perhatikan bagaimana kata-kata itu berhubungan satu sama lain dan kemudian perkirakan kata-kata apa yang menurutnya akan muncul selanjutnya.

Namun tidak seperti kebanyakan model bahasa lainnya, LaMDA dilatih tentang dialog. Selama pelatihannya, ia mampu menangkap beberapa nuansa yang membedakan percakapan terbuka dari bentuk bahasa lainnya.

Salah satu nuansa itu adalah kepekaan. Pada dasarnya: Apakah respons terhadap konteks percakapan tertentu masuk akal? Misalnya, jika seseorang mengatakan:

“Saya baru saja mulai mengambil pelajaran gitar.”

Kalian mungkin mengharapkan orang lain untuk merespons dengan sesuatu seperti:

“Menarik sekali! Ibuku punya Martin klasik yang dia suka mainkan.”

Tanggapan itu masuk akal, mengingat pernyataan awal. Tetapi akal sehat bukanlah satu-satunya hal yang membuat tanggapan yang baik. Lagi pula, frasa “itu bagus” adalah respons yang masuk akal untuk hampir semua pernyataan, seperti halnya “Saya tidak tahu” adalah respons yang masuk akal untuk sebagian besar pertanyaan. Tanggapan yang memuaskan juga cenderung spesifik, dengan mengaitkan secara jelas dengan konteks pembicaraan. Dalam contoh di atas, responsnya masuk akal dan spesifik.

LaMDA dibuat berdasarkan penelitian Google sebelumnya, yang diterbitkan pada tahun 2020, yang menunjukkan bahwa model bahasa berbasis Transformer yang dilatih dalam dialog dapat belajar berbicara tentang hampir semua hal.

Sejak saat itu, pihak Google juga menemukan bahwa, setelah dilatih, LaMDA dapat disesuaikan untuk secara signifikan meningkatkan kepekaan dan spesifisitas responsnya.

Google AI Mengutamakan Tanggung Jawab

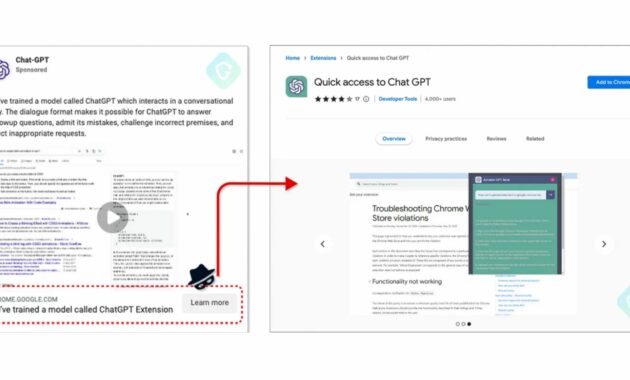

Hasil awal dari LaMDA terbilang memuaskan, Google masih mengujinya dalam lingkup internal saja. Nantinya mungkin dapat segera membagikannya. Mengingat kompetitor lain sudah lebih dulu populer seperti ChatGPT dari Open AI.

Namun kepekaan dan spesifisitas bukanlah satu-satunya kualitas yang dicari dalam model seperti LaMDA. Ada juga dimensi seperti “ketertarikan”, dengan menilai apakah respons bersifat mendalam, tidak terduga, atau jenaka.

Google sangat peduli dengan faktualitas (yaitu, apakah LaMDA berpegang pada fakta, sesuatu yang sering dipermasalahkan oleh model bahasa), dan sedang menyelidiki cara untuk memastikan respons LaMDA tidak hanya menarik tetapi juga benar. Nah, hal inilah yang masih menjadi kelemahan ChatGPT.

Namun Google berkomitmen bahwa teknologinya tersebut akan selalu mematuhi Prinsip AI Google. Bahasa mungkin merupakan salah satu alat terbesar umat manusia, tetapi seperti semua alat, bahasa dapat disalahgunakan.

Model yang terlatih dalam bahasa dapat menyebarkan penyalahgunaan tersebut. Misalnya, dengan menginternalisasi bias, mencerminkan ujaran kebencian, atau mereplikasi informasi yang menyesatkan.

Bahkan ketika bahasa yang dilatihnya diperiksa dengan hati-hati, model itu sendiri masih dapat digunakan dengan buruk.

Prioritas tertinggi Google saat membuat teknologi seperti LaMDA, agar mampu bekerja dengan baik untuk memastikan bahwa teknologinya meminimalkan risiko tersebut.

Masalah terkait dengan model pembelajaran mesin, seperti bias yang tidak adil, semacam ini jelas begitu dipahami oleh Google. Sebab telah meneliti dan mengembangkan teknologi ini selama bertahun-tahun.

Oleh sebab itu, Google membangun sumber daya terbuka yang dapat digunakan peneliti dalam menganalisis model dan data tempat mereka dilatih.

Meneliti LaMDA di setiap langkah pengembangannya; dan mengapa akan terus melakukannya saat berupaya menggabungkan kemampuan percakapan ke lebih banyak produk Google.

Bayangkan saja dulu, bagaimana nantinya jika teknologi semacam ini digunakan oleh robot. Membayangkan robot dengan kepekaan yang tinggi terhadap manusia saat ini jelas bisa menjadi terobosan luar biasa.

Mengingat manusia sekarang justru terlihat seperti robot, yang kaku dan tidak memiliki kepekaan.

Leave a Comment